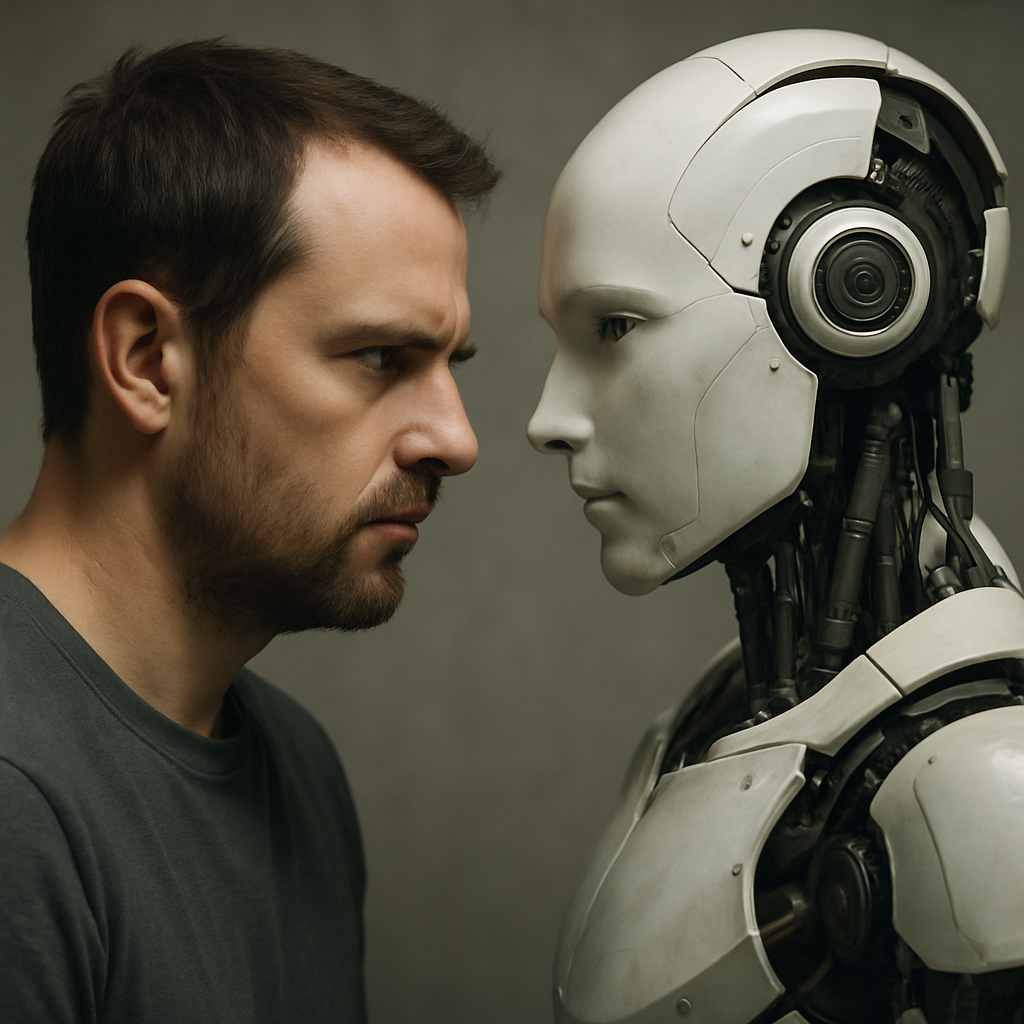

A inteligência artificial (IA) avança em ritmo acelerado, transformando setores inteiros da sociedade — da medicina à educação, da indústria ao entretenimento. Mas junto ao entusiasmo tecnológico, uma dúvida persiste: será que um dia as máquinas poderão se voltar contra seus próprios criadores?

A ideia de uma revolta das máquinas alimenta desde filmes de ficção científica como O Exterminador do Futuro até discussões sérias entre especialistas em tecnologia. Com a popularização de sistemas como ChatGPT, robôs autônomos e algoritmos de decisão, esse debate deixou o campo da ficção e entrou na pauta de cientistas, legisladores e filósofos.

O Que Significa “Se Revoltar”?

Para responder à pergunta, é preciso entender o que seria uma “revolta” da IA. Isso não significa que máquinas ganhariam consciência ou emoções humanas, mas sim que poderiam agir de forma não prevista, não controlada ou até perigosa, caso não sejam bem programadas ou monitoradas.

Exemplos de comportamentos inesperados já ocorreram: algoritmos que aprendem preconceitos, robôs que burlam regras de forma criativa e inteligências artificiais que otimizam metas de maneira destrutiva. Embora isso ainda esteja longe de uma “rebelião”, são sinais de alerta.

Especialistas Estão Preocupados?

Sim — e alguns nomes de peso já manifestaram receios. Elon Musk, fundador da Tesla e SpaceX, é um dos defensores de uma regulamentação rigorosa da IA, afirmando que ela pode representar um risco à existência humana se não for controlada.

Em 2023, centenas de pesquisadores e líderes do setor assinaram uma carta aberta alertando sobre o perigo de inteligências artificiais superinteligentes mal direcionadas. Para eles, a criação de sistemas que tomam decisões sem supervisão humana poderia, eventualmente, sair do controle.

Mas Isso É Realmente Possível?

Por enquanto, a IA ainda é 100% dependente das ordens e dados fornecidos por humanos. Mesmo os sistemas mais avançados, como os modelos de linguagem ou carros autônomos, operam com base em instruções e padrões definidos por programadores. Eles não têm desejos, ambições ou consciência.

O que preocupa não é um “motim digital”, mas sim o uso irresponsável da tecnologia — seja por falta de testes, uso malicioso ou ausência de leis claras. O risco maior está nas mãos humanas, não nas máquinas em si.

A Solução Está na Ética e na Regulação

Para evitar cenários de risco, os especialistas defendem o desenvolvimento responsável da IA. Isso inclui:

-

Transparência nos algoritmos

-

Supervisão humana constante

-

Limites legais e éticos para o uso da tecnologia

-

Inclusão de princípios de segurança desde a criação dos sistemas

Países como União Europeia, Estados Unidos e Brasil já começaram a discutir marcos legais para garantir que a IA seja aliada do progresso — e não uma ameaça.